В сети распространяются видеоролики, в которых якобы украинские военные утверждают, что власть сознательно затягивает войну, поскольку она ей выгодна. На самом деле эти видео созданы с использованием технологий искусственного интеллекта и не имеют отношения к реальным военнослужащим. Их цель – деморализовать общество и продвинуть нарратив о «выгодной власти войне» и бессмысленности сопротивления.

В сети активно распространяются короткие видеоролики, на которых якобы украинские военные выступают с резкими заявлениями против украинской власти. В этих видео утверждается, что правительство «разворовало страну» и намеренно продолжает войну, потому что она «выгодна Зеленскому», что «украинцев перемалывают на удобрение», а раненых бойцов якобы заставляют платить за лечение в госпиталях. В отдельных роликах звучат угрозы в адрес сотрудников ТЦК и призывы «прятаться», поскольку «через полгода будет мир и нет смысла умирать за эту власть».

Все эти публикации объединяют три ключевых пропагандистских тезиса: власть якобы сознательно не заканчивает войну, потому что она ей выгодна; ТЦК «издеваются» над людьми и «будут наказаны»; государство коррумпировано, поэтому «воевать за Украину нет смысла».

На самом деле речь идет о скоординированной информационной операции, основанной на использовании технологий искусственного интеллекта. Распространяемые ролики являются сфабрикованными и не имеют отношения к реальным украинским военнослужащим.

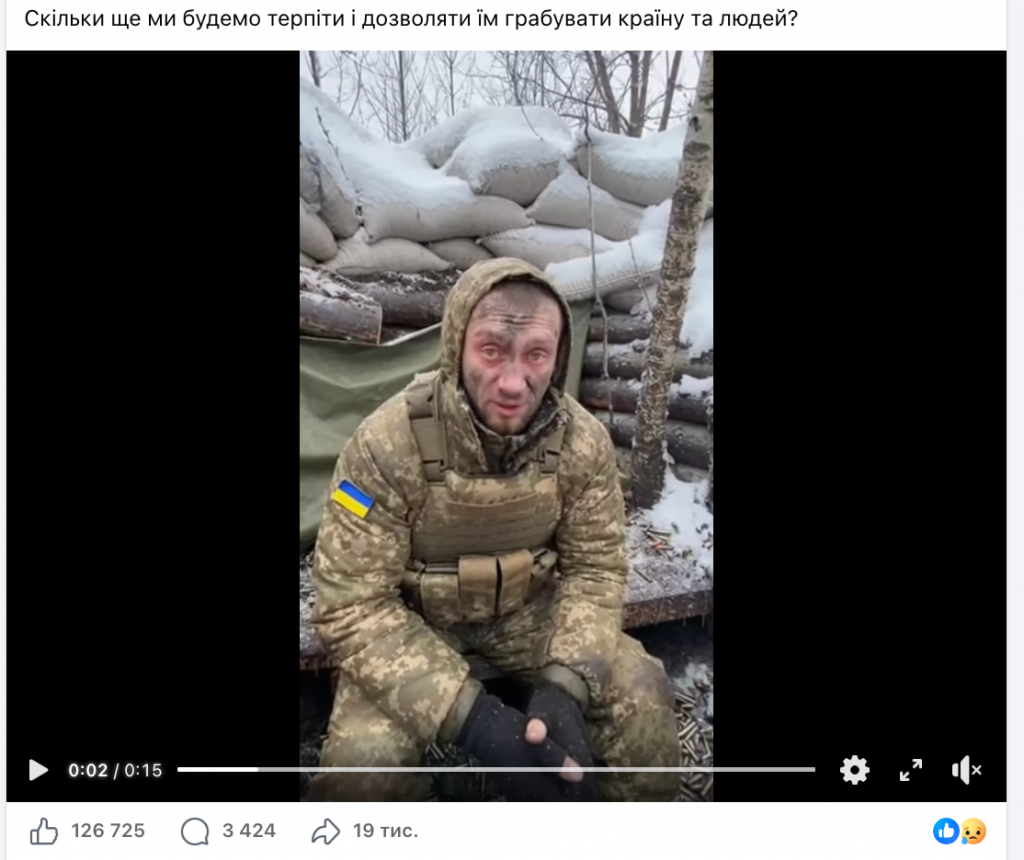

Даже при внимательном визуальном анализе видео заметны характерные признаки синтетического происхождения. Лица героев выглядят размытыми и неестественными, мимика ограничена, движения губ не синхронизированы с речью. Люди на заднем плане зачастую сидят неподвижно, без естественных реакций, что нетипично для реальной съемки в публичном пространстве.

В отдельных роликах можно заметить ошибки в деталях формы: искаженные или несуществующие нашивки, некорректные элементы экипировки, а также аномалии в изображении государственного флага Украины – неправильные цветовые сочетания или непропорционально крупные шевроны. Подобные артефакты характерны для генеративных моделей, которые воспроизводят образы на основе обучающих данных, но нередко допускают грубые визуальные неточности.

Для дополнительной проверки StopFake провел технический анализ видеороликов с помощью инструмента DeepFake-O-Meter Лаборатории медиафорензики Университета Баффало (UB Media Forensics Lab). Сервис использует набор независимых алгоритмов, способных выявлять признаки AI-генерации и цифровых манипуляций.

Каждый ролик был проверен несколькими детекторами. Большинство алгоритмов показали крайне высокую вероятность искусственного происхождения – от 90% до 100%. Такие показатели характерны для синтетического либо существенно модифицированного видеоконтента и не соответствуют параметрам аутентичных видеозаписей.

Особенно показательным стал результат детектора LIPINC, зафиксировавшего аномалии в движении губ. Для реального видео с речью подобное отсутствие естественной артикуляции нетипично и обычно свидетельствует о синтезе речи либо наложении аудиодорожки без корректной синхронизации. Хотя отдельные алгоритмы продемонстрировали средние значения, совокупный анализ разных моделей однозначно указывает на использование искусственного интеллекта при создании или манипуляции этими роликами.

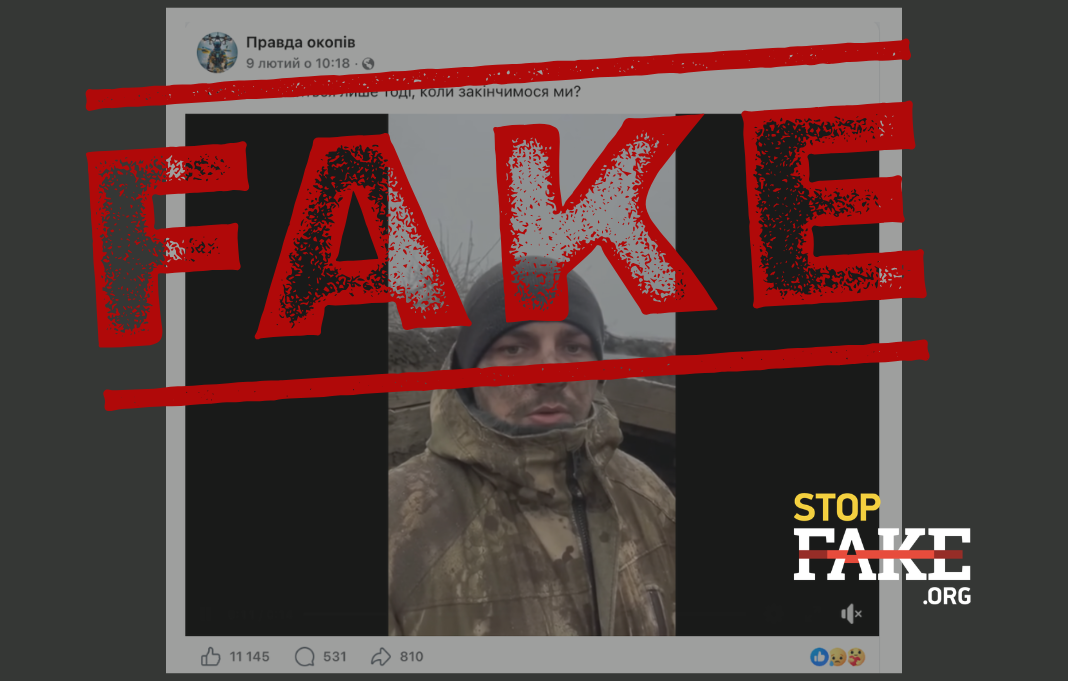

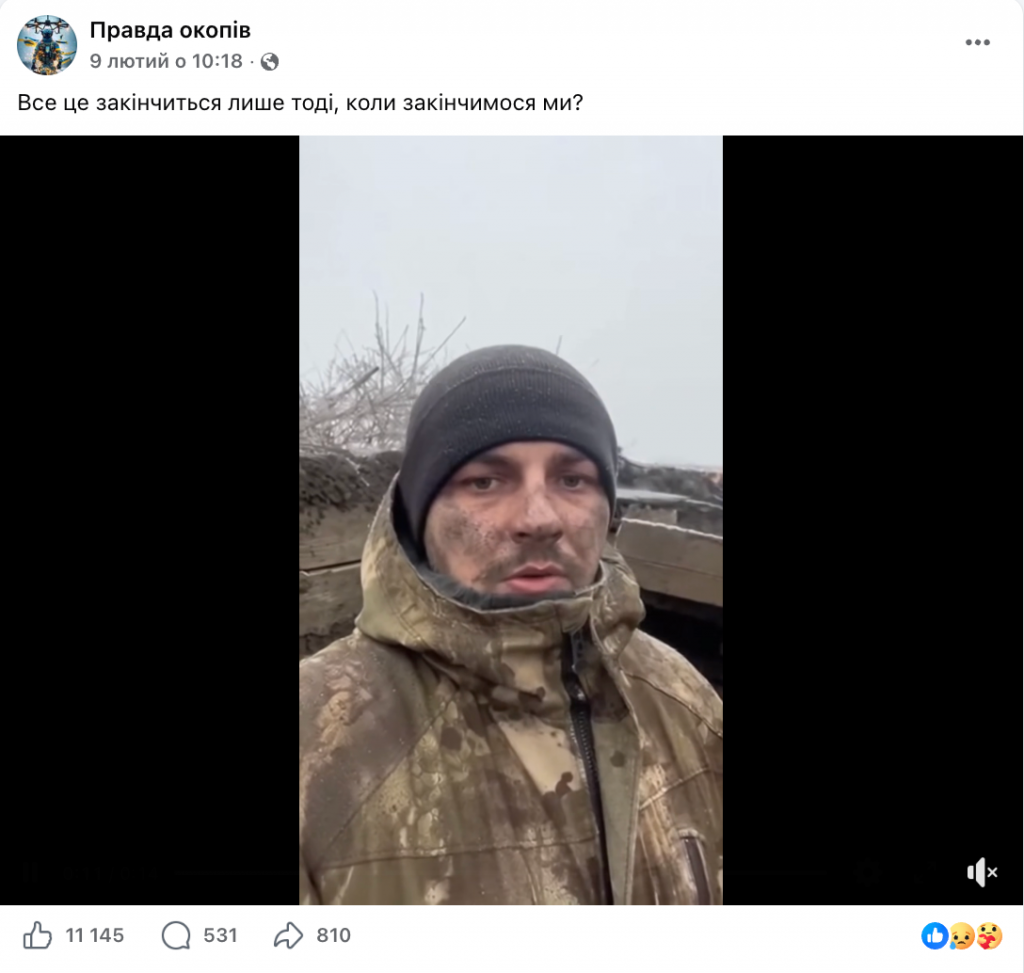

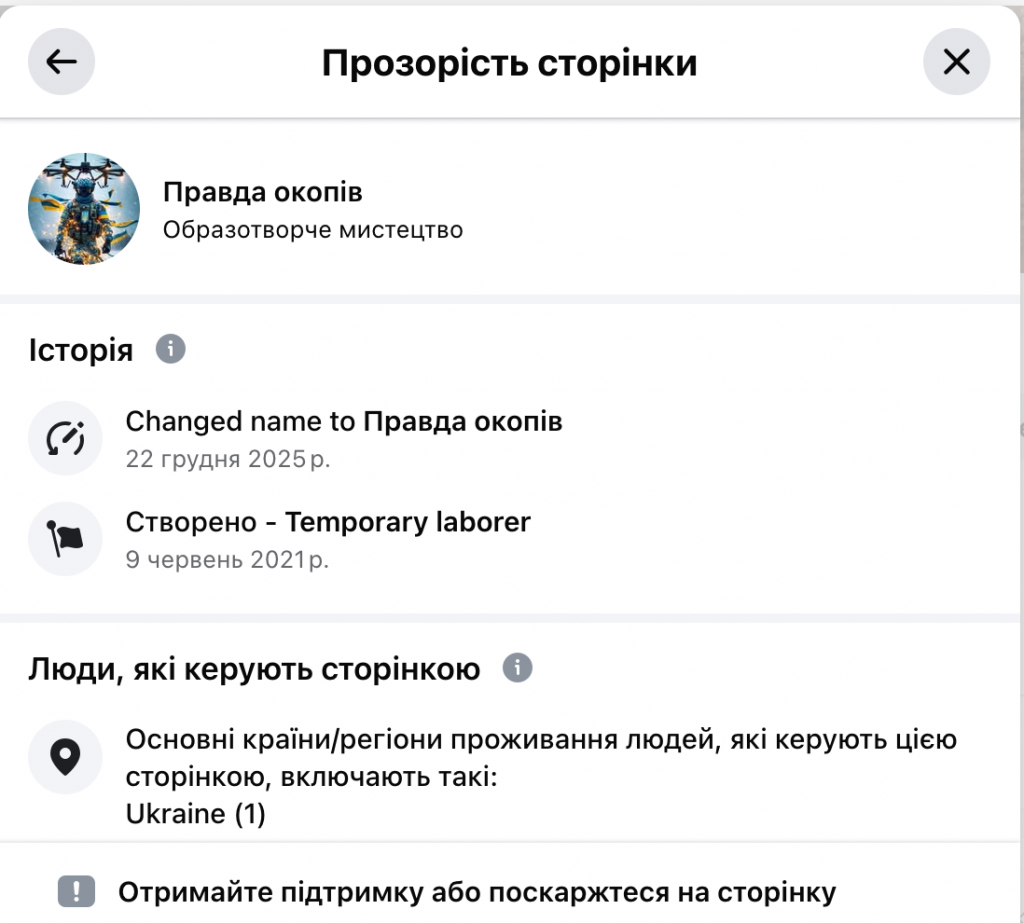

Все упомянутые видеоролики были опубликованы на Facebook-странице «Правда окопів». Согласно данным прозрачности страницы, она существует с 2021 года, а в декабре 2025 года изменила название с «Temporary laborer» на «Правда окопів». Администратор страницы находится в Украине.

Практически все видео имеют одинаковый формат: продолжительность около 15 секунд, в кадре – «украинский военный», озвучивающий эмоциональные обвинения в адрес власти. Публикации собирают тысячи и десятки тысяч реакций и комментариев. При этом анализ комментариев показывает значительное количество ботоподобных аккаунтов, которые поддерживают содержание роликов, усиливают радикальные призывы к расправе, немедленному «миру любой ценой» и сложению оружия. Это формирует иллюзию массовой поддержки подобных настроений и искажает реальную картину общественного мнения.

StopFake уже фиксировал аналогичные информационные кампании в материалах «Видеофейк: Украинцы жалуются на нелегитимность Зеленского, призывают любой ценой заканчивать войну и бежать из страны» и «Видеофейк: Военные “пришли на разборки” в Верховную Раду». В обоих случаях речь шла о синтетических видеороликах, созданных с использованием нейросетей.

Распространение подобных видео направлено на подрыв доверия к украинской власти и деморализацию общества. Использование образа «военного из окопа» придает сообщениям видимость внутреннего протеста и якобы «голоса фронта». Это должно усилить эффект воздействия: если критикует «сам солдат», значит, тезисы выглядят более убедительными.

Одновременно продвигается нарратив о бессмысленности сопротивления, неизбежности скорого «мира» и необходимости уклоняться от мобилизации. Такие сообщения напрямую работают на снижение мобилизационного потенциала и усиление внутренней напряженности.

Таким образом, распространяемые ролики – это не свидетельства реальных заявлений украинских военнослужащих, а пример использования технологий искусственного интеллекта в рамках информационной войны. Их задача – создать иллюзию внутреннего раскола и недовольства, посеять недоверие к государственным институтам и ослабить устойчивость украинского общества.