Цзен Хуэй-вэнь, Чен Вэй-тин

Оригинал публикации можно прочитать здесь.

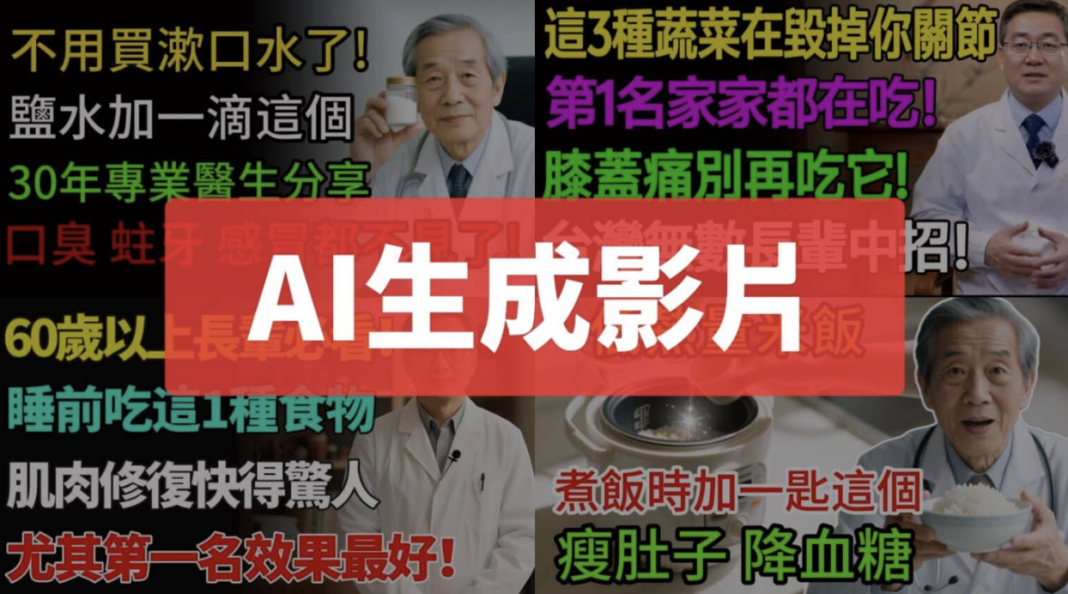

Наверное, вы замечали, что, когда ищете информацию о здоровье на видеоплатформах, часто встречаете привлекательные, сенсационные ролики, якобы опровергающие общепринятые представления. Когда вы нажимаете на них, обычно там цитируют высказывания, якобы принадлежащие опытному врачу, а затем приводят несколько «кейсов» и ссылаются на «авторитетные» медицинские исследования, из-за чего зрители начинают испытывать беспокойство.

Если просмотреть еще несколько подобных видео, можно заметить, что они в основном имеют одинаковую структуру и шаблонный формат. Оказывается, эти видео созданы с помощью искусственного интеллекта.

Хотя содержание таких видео часто изобилует ошибками, оно подается в профессиональном, серьезном тоне, что усложняет зрителям возможность различать правду и вымысел. Эксперты предупреждают: поскольку производство видео на основе ИИ дешевое и быстрое, оно уже превратилось в отдельную бизнес-модель. Информация в этих роликах часто является смесью правды и лжи, поэтому гражданам следует быть бдительными и избегать безоговорочной веры в такие видео и их дальнейшего распространения.

Три основные черты ИИ-сгенерированных видео о здоровье

Тайваньский центр проверки фактов (Taiwan FactCheck Center) отметил, что видео о здоровье, созданные с помощью ИИ и массово распространенные в интернете, обычно имеют три общие черты: сенсационные кликбейтные заголовки, вымышленные персонажи и сюжеты, а также расплывчатые, неконкретные утверждения.

Например, в видео с утверждением, что «разогревание остатков риса в микроволновке вредно для здоровья» заголовок предупреждает, что охлажденный рис вроде бы нельзя разогревать в микроволновке, а описание обещает научить зрителей готовить низкокалорийный рис, способный снизить уровень сахара в крови, – эта новость очень эффективно привлекает внимание.

Впрочем, при более детальном просмотре оказывается, что в начале рассказчик представляется 85-летним врачом с 55-летним стажем, а уже через две минуты меняет его на 35 лет — это противоречие дает основания полагать, что персонаж выдуманный.

В видео также упоминаются многочисленные исследования, такие как «исследование Гарвардской школы общественного здоровья им. Т. Х. Чана 2022 года», «исследования Медицинского центра Джонса Хопкинса», «исследования группы профессора Ямады из Токийского университета в Японии» и «исследования Оксфордского университета» — но эти ссылки нечеткие и не содержат точных библиографических данных. Фактчекеры попытались осуществить поиск по разным ключевым словам, но не смогли найти ни одной соответствующей публикации.

На YouTube есть много подобных каналов, которые загружают большое количество видео о здоровье в том же стиле, используя сенсационные, преувеличенные заголовки типа «Употребление этих 3 овощей разрушает ваши суставы», «Люди солидного возраста: ешьте эти 8 продуктов перед сном и наращивайте мышцы, пока спите», «Соленая вода — сильнейший ополаскиватель для рота» и «Шокирующая тайна базилика». Все эти заголовки созданы для того, чтобы привлечь внимание, а проверка Тайваньского центра проверки фактов показывает, что такие ролики содержат значительное количество ложной информации.

Когда «медицинские советы» ИИ подталкивают к рискованному поведению

Доцент Института инженерии тканей полости рта и биоматериалов Национального университета Ян-Мин-Чжао-Тун Лин Ю-чен отмечает: в медицине корреляция не равна причинно-следственной связи. Когда врачи или ученые обсуждают медицинские исследования, они обычно очень осторожны, ведь медицина постоянно развивается и выводы многих исследований остаются предварительными. Если люди в интернете сталкиваются с видео, где звучат категорические утверждения, противоречащие повседневному опыту, – например, «рисовые блюда из микроволновки вредны для здоровья» или «употребление баклажанов разрушает суставы», – существует высокая вероятность, что с таким контентом что-то не так. Не стоит сразу верить подобным заявлениям и тем более распространять их.

Диетолог больницы Taipei Post Хуан Шу-хуэй также обратила внимание на «наводнение» ИИ-сгенерированных видео о здоровье. Она предостерегает: эти ролики часто «бесконечно преувеличивают пользу отдельного ингредиента» и используют «полуправдивые, полуложные утверждения» — типичную риторику распространения дезинформации о здоровье. Зрителям следует быть особенно бдительными, когда они сталкиваются с подобным контентом.

Доцент Института поведения в сфере здоровья и общественных наук Национального университета Тайваня Хуан По-яо отмечает, что такого рода ИИ-сгенерированные видео о здоровье часто излишне упрощают сложные связи между поведением и рисками, предлагая слишком упрощенное обещание: «Просто сделайте А – и получите Б».

По его мнению, когда все больше людей полагаются на такие «быстрые решения» вместо профессиональных медицинских советов, последствия могут варьироваться от неправильного питания или причиняющего вред поведения до усиления информационного неравенства и необратимого вреда здоровью. Часть людей, искренне веря в содержание ИИ-сгенерированных видео, может откладывать обращение за медицинской помощью и в конце концов потерять «золотой период» для лечения. Это создает серьезные вызовы как для здоровья отдельных людей, так и для системы общественного здоровья в целом.

Когда производство видео с помощью ИИ становится настоящей индустрией

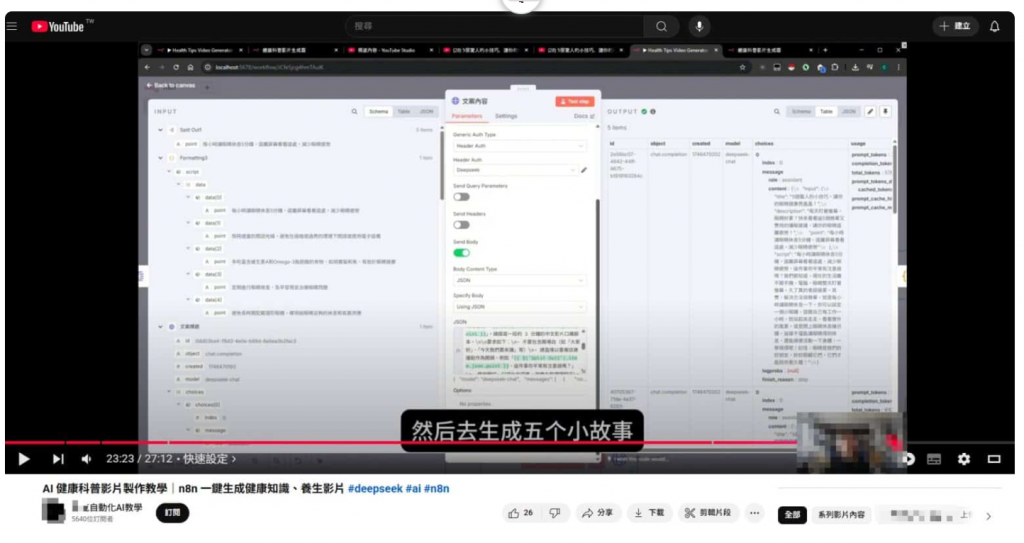

Эксперты Национального института кибербезопасности Тайваня отмечают, что многие такие ролики, вероятнее всего, создают с помощью программ типа Jianying: в рамках единого рабочего процесса ИИ генерирует текст, визуальные материалы, монтирует видео и добавляет озвучку. Это позволяет массово выпускать подобные ролики за короткое время и распространять их на разных платформах.

Сочетание монтажных приложений и ИИ_масштабирования почти обнуляет стоимость производства таких видео. Контент часто выглядит правдоподобно и профессионально, но содержит вымышленные и манипулятивные элементы — так называемые «галлюцинации» искусственного интеллекта. Человеку сложно отличить правду от лжи – и это одна из ключевых опасностей данной технологии.

Тайваньский центр проверки фактов (Taiwan FactCheck Center) также фиксирует: «обучение и помощь пользователям в создании видео с помощью ИИ» уже превратились в отдельную нишу рынка. Многие платные ИИ-инструменты предлагают разнообразные шаблоны и форматы видео — озвучивание цифровыми аватарами, текст в анимацию, автоматическая сборка видео с картинок и текста. Пользователю иногда достаточно ввести одно предложение, чтобы система сгенерировала сценарий, а затем автоматически создала короткий ИИ-ролик одним нажатием.

Кроме того, некоторые пользователи применяют DeepSeek для подобных рабочих процессов по созданию видео на медицинские темы. Оплатив за членство и заполнив форму (с темой – например, глаза, сердце или легкие – и типом видео, например, советы по здоровью или возможные последствия), пользователь автоматически получает сгенерированный заголовок, вступление и полный сценарий. Далее текст озвучивает ИИ-синтез голоса, к нему подбираются соответствующие изображения и другие материалы — так автоматически синтезируется полноценное видео о здоровье.

Этот рабочий процесс не ограничивается темами здоровья; изменив запрос, его можно легко применить к финансам, советам на каждый день, образованию, политике и законодательству, домашним животным, историям о привидениях и т.д. Поскольку создание видео с помощью искусственного интеллекта теперь можно осуществлять без ручного редактирования и написания сценария, барьеры для производства чрезвычайно низки. В последние годы такие видео заполонили платформы типа YouTube, а затем распространились и дальше — на личные страницы в Facebook и в группы.

Как видео с искусственным интеллектом влияют на «эмоциональный мозг»

Видеоролики, созданные с помощью ИИ на основе вымышленных историй, предназначены для активации «эмоционального мозга». Доцент Национального университета Ян-Мин-Чжао-Тун Сю Чжи-чун напоминает, что еще во время «инцидента с подменой лица с помощью технологии deepfake, связанного с Сяою», произошедшего в 2021 году, в сети уже распространялись учебные материалы по замене лица с помощью deepfake, которые постепенно преобразовались. Он говорит, что видео, созданные искусственным интеллектом, распространяющимися на разных платформах, в первую очередь предназначены для привлечения трафика, поэтому тема должна быть привлекательной и оригинальной. Темы сменяются волнами, чтобы поддерживать новизну, и сенсационные видео о здоровье являются одним из примеров того, как легко привлечь внимание общественности.

Сю Чжи-чун считает, что в случае видео о здоровье люди, которые их создают и распространяют, не всегда действуют по злому умыслу; возможно, они сами не способны отличить правду от лжи. Поскольку контент, созданный искусственным интеллектом, генерируется на основе человеческих инструкций, система не несет ответственности за то, что она создает. Как следствие, эти видео о здоровье, созданные искусственным интеллектом, часто содержат смесь правдоподобных и ложных материалов, и им не следует доверять.

Он также объясняет, что «эмоциональный мозг» человека обычно реагирует быстрее, чем «рациональный мозг», поэтому такие видео часто начинаются с вымышленных персонажей, обстановки или сюжетных линий, а потом уже переходят к основному тезису. Когда эмоции зрителей уже задеты, они реже ставят под сомнение правдивость утверждений.

Например, такие видео могут начинаться так: «Я — доктор Чжэн Шэн-мин, мне 85 лет, у меня 55 лет клинического опыта»; «70-летний господин Линн из Тайчжуна очень тщательно следит за здоровым питанием… через шесть месяцев его колени настолько отекли и болели, что ему понадобилась палка для ходьбы»; или «После 12 лет приема лекарства от диабета состояние 67-летней госпожи Лин Мэй-цао ухудшилось, но, изменив лишь способ приготовления риса в течение пяти месяцев, она пережила чудо…» Эти рассказы призваны шаг за шагом погружать зрителей в вымышленный мир, созданный искусственным интелектом.

Хуан По-яо также отметил, что такие видео о здоровье, созданные искусственным интеллектом, часто создают у людей иллюзию «человеческого облика», наделяя их «научной авторитетностью» и предлагая «универсальное решение» сложных медицинских проблем за очень короткое время. Это напоминает некоторых красноречивых псевдоэкспертов или инфлюэнсеров, которые кажутся надежными, но на самом деле не имеют соответствующей профессиональной подготовки.

Это ощущение достоверности является одной из причин, делающих дезинформацию о здоровье, созданную ИИ, убедительной: она имитирует язык экспертов, использует структурированные объяснения и представляет себя в качестве исчерпывающей, даже если основные утверждения являются ненадежными.

Когда интернет переполнен ИИ-контентом, настоящим лекарством становятся ИИ-грамотность и образование

Кроме распространения видео о здоровье, созданных искусственным интеллектом, все больше людей обращаются в ИИ за «медицинскими консультациями», описывая системе свои симптомы или беспокойство в надежде получить ответы. Сю Чжи-чун напоминает: даже если ИИ кажется правым в большинстве случаев, «быть правым в большинстве случаев не значит быть правым всегда».

По словам Хуана По-яо, «консультации» ИИ можно разделить на два уровня. Первый касается относительно распространенных моделей поведения, связанных со здоровьем, — например, поиск с помощью ИИ информации о фитнесе, питании или общих симптомах. Риски здесь ниже, ведь если совет окажется ошибочным, организм часто быстро подает ответные сигналы. Второй уровень гораздо опаснее и касается психического здоровья и медицинских решений. Исследования и журналистские расследования показали: иногда ИИ отвечает неадекватно, а иногда даже, казалось бы, поощряет самоповреждение или самоубийство. В таких случаях использование технологий в самопомощи и «интимной» коммуникации смещается от установки «я хочу поговорить с человеком» до ложного ощущения «я думаю, что разговариваю с человеком».

Хуан объясняет, что алгоритмы искусственного интеллекта не созданы для того, чтобы «заботиться» о человеке; их цель — производить предполагаемые ответы. ИИ может быстро генерировать множество правдоподобных рекомендаций, однако ему не хватает контекста и клинического мышления, необходимых для обоснованных медицинских выводов. Когда люди чрезмерно полагаются на инструменты ИИ, чтобы интерпретировать собственные симптомы, они могут опоздать с обращением за профессиональной помощью и потерять лучшее время для лечения. Это не только сбивает с толку индивидуальное поведение в сфере здоровья, но и может ослабить доверие к системе здравоохранения и усложнить реализацию политики в сфере общественного здоровья.

Хуан также отмечает, что в начале цифровой эры распространение информации о здоровье оставалось тесно связанным с межличностной опекой, тогда как в эпоху ИИ такие взаимодействия все больше напоминают цифровой «спектакль». Взаимодействие человека и ИИ поднимает вопросы конфиденциальности и сбора данных: информация о состоянии здоровья и частные разговоры могут превращаться в ресурсы данных, которые используют в целях, далеких от заботы о пациенте.

Он отмечает, что «сходство с человеком» и «иллюзия научной авторитетности», которые создают ИИ-сгенерированные видео, не являются настоящими научными суждениями или проявлением заботы. По мере того как ИИ все глубже укореняется в повседневную жизнь, формирование основательной ИИ-грамотности становится одним из ключевых вызовов в сфере здравоохранения.

Сю Чжи-чун добавляет: контент, созданный ИИ, уже стал повсеместным, поэтому общественность, прежде всего, должна осознать, что значительная часть того, с чем она сталкивается в интернете, могла быть сгенерирована ИИ. Не следует воспринимать все увиденное как чистую монету. В будущем доля онлайн-контента, созданного ИИ, будет только расти. По мере развития технологий и увеличения объемов ИИ контента роль человеческого обучения становится еще более важной: только благодаря образованию, постоянному обучению и сознательному использованию ИИ-инструментов люди смогут развить способность отличать правду от дезинформации.

Перепубликован с веб-сайта TFC в сотрудничестве со StopFake в рамках Ukraine-Taiwan Initiative for Election Information Resilience.