У мережі розповсюджуються відеоролики, в яких нібито українські військові стверджують, що влада свідомо затягує війну, оскільки вона їй вигідна. Насправді ці відео створені з використанням технологій штучного інтелекту і не мають стосунку до реальних військовослужбовців. Їхня мета – деморалізувати суспільство і просунути наратив про «вигідну владі війну» та марність спротиву.

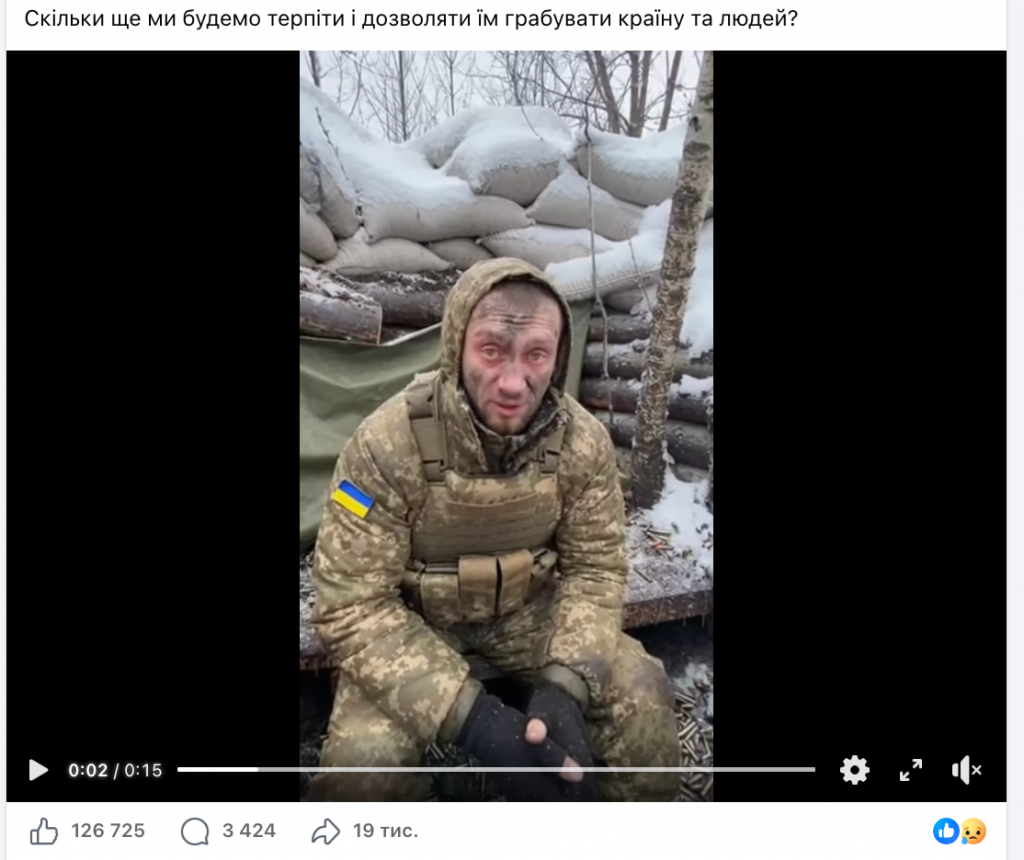

У мережі активно поширюються короткі відеоролики, на яких нібито українські військові виступають із різкими заявами проти української влади. У цих відео стверджується, що уряд «розікрав країну» і навмисне продовжує війну, бо вона «вигідна Зеленському», що «українців перемелюють на добриво», а поранених бійців нібито змушують платити за лікування у шпиталях. В окремих роликах звучать погрози на адресу співробітників ТЦК та заклики «ховатися», оскільки «через пів року буде мир і немає сенсу вмирати за цю владу».

Усі ці публікації поєднують три ключові пропагандистські тези: влада нібито свідомо не закінчує війну, бо вона їй вигідна; ТЦК «знущаються» з людей і «будуть покарані»; держава корумпована, тому «воювати за Україну немає сенсу».

Насправді йдеться про скоординовану інформаційну операцію, засновану на використанні технологій штучного інтелекту. Вірусні ролики є сфабрикованими і не мають нічого спільного із реальними українськими військовослужбовцями.

Навіть за уважного візуального аналізу відео помітні характерні ознаки синтетичного походження. Обличчя героїв виглядають розмитими та неприродними, міміка обмежена, рухи губ не синхронізовані з мовою. Люди на задньому плані часто сидять нерухомо, без природних реакцій, що нетипово для реальної зйомки у публічному просторі.

В окремих роликах можна помітити помилки в деталях форми: спотворені чи неіснуючі нашивки, некоректні елементи екіпірування, а також аномалії у зображенні державного прапора України – неправильні поєднання кольорів або непропорційно великі шеврони. Такі артефакти характерні для генеративних моделей, які відтворюють образи на основі навчальних даних, але нерідко допускають грубі візуальні неточності.

Для додаткової перевірки StopFake провів технічний аналіз відео за допомогою інструменту DeepFake-O-Meter Лабораторії медіафорензики Університету Баффало (UB Media Forensics Lab). Сервіс використовує набір незалежних алгоритмів, здатних виявляти ознаки AI-генерації та цифрових маніпуляцій.

Кожен ролик було перевірено кількома детекторами. Більшість алгоритмів показали дуже високу ймовірність штучного походження – від 90% до 100%. Такі показники характерні для синтетичного або суттєво модифікованого відеоконтенту і не відповідають параметрам автентичних відеозаписів.

Особливо показовим став результат детектора LIPINC, який зафіксував аномалії руху губ. Для реального відео з розмовою така відсутність природної артикуляції нетипова і зазвичай свідчить про синтез мовлення або накладення аудіодоріжки без коректної синхронізації. Хоча окремі алгоритми продемонстрували середні значення, сукупний аналіз різних моделей однозначно вказує на використання штучного інтелекту під час створення чи маніпуляції з цими роликами.

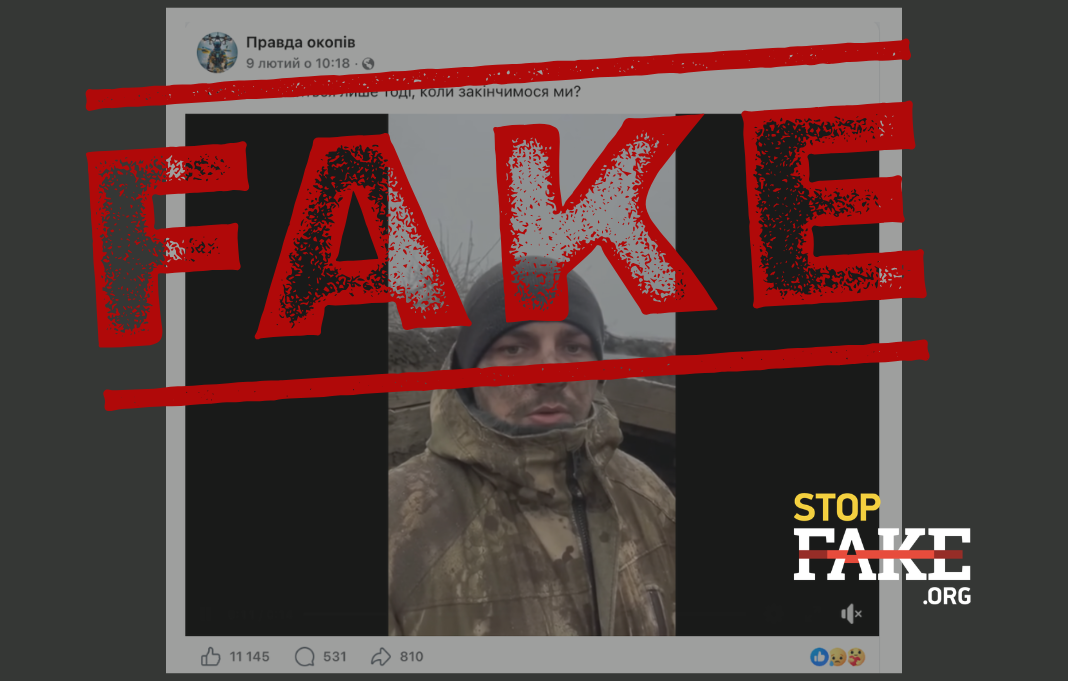

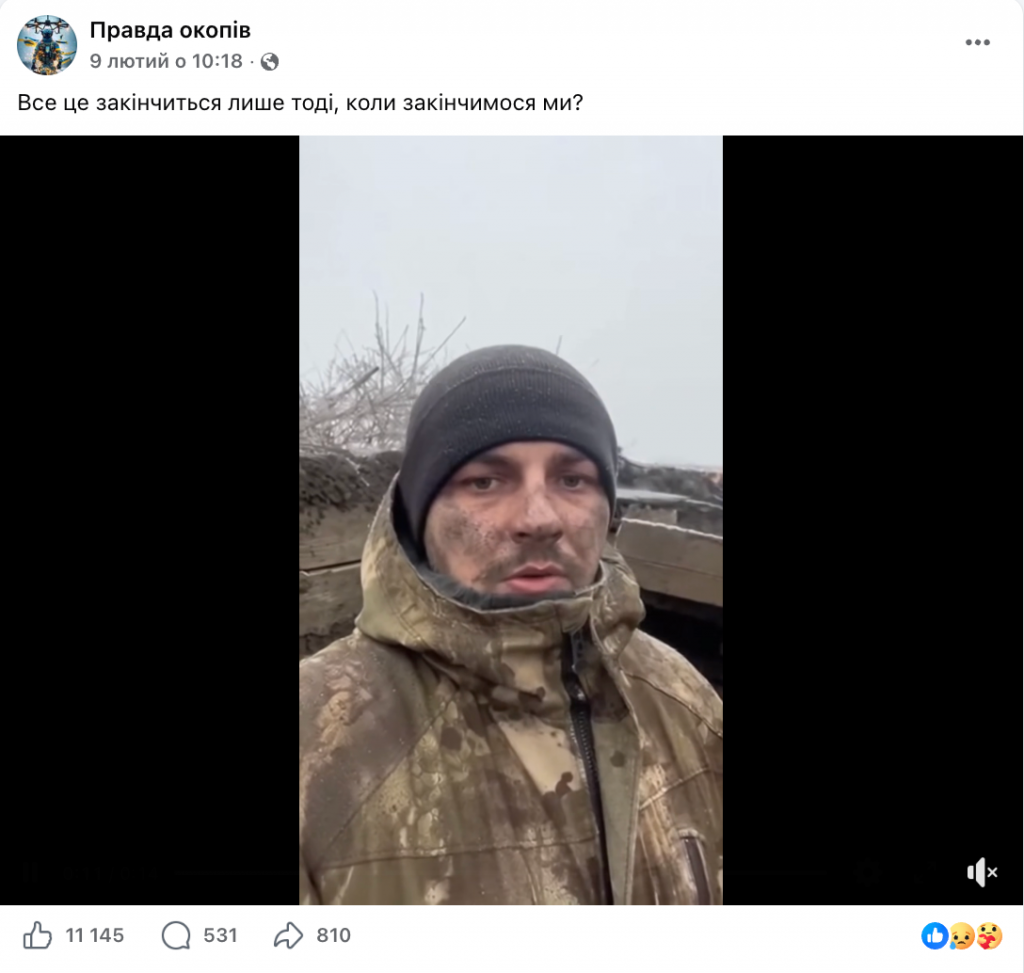

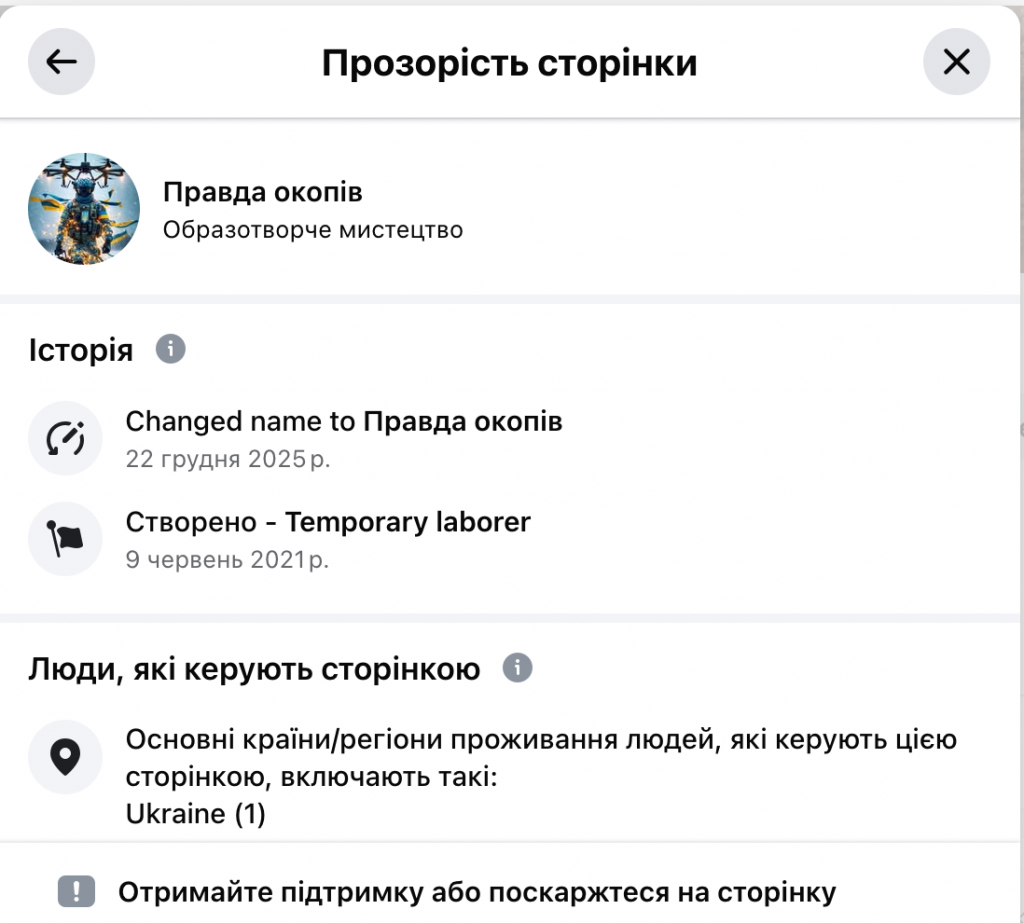

Усі згадані відеоролики опубліковано на Facebook-сторінці «Правда окопів». Згідно з даними прозорості сторінки, вона існує з 2021 року, а в грудні 2025 року змінила назву з «Temporary laborer» на «Правда окопів». Адміністратор сторінки перебуває в Україні.

Практично всі відео мають однаковий формат: тривалість приблизно 15 секунд, у кадрі – «український військовий», який озвучує емоційні звинувачення на адресу влади. Публікації збирають тисячі та навіть десятки тисяч реакцій і коментарів. При цьому аналіз коментарів показує значну кількість ботоподібних облікових записів, які підтримують зміст роликів, посилюють радикальні заклики до розправи, негайного «миру за будь-яку ціну» та складання зброї. Це формує ілюзію масової підтримки таких настроїв і спотворює реальну картину громадської думки.

StopFake вже фіксував аналогічні інформаційні кампанії у матеріалах «Відеофейк: Українці скаржаться на нелегітимність Зеленського, закликають за будь-яку ціну закінчувати війну та тікати з країни» та «Відеофейк: Військові “прийшли на розбірки” до Верховної Ради». В обох випадках йшлося про синтетичні відеоролики, створені з використанням нейромереж.

Поширення таких відео спрямоване на підрив довіри до української влади та деморалізацію суспільства. Використання образу «військового з окопу» надає повідомленням видимості внутрішнього протесту та нібито «голосу фронту». Це має посилити ефект впливу: якщо критикує сам солдат, значить, тези виглядають більш переконливими.

Одночасно просувається наратив про безглуздість спротиву, неминучість швидкого «миру» та необхідність ухилятися від мобілізації. Такі повідомлення безпосередньо працюють на зниження мобілізаційного потенціалу та посилення внутрішньої напруженості.

Отже, такі ролики – це не свідчення реальних заяв українських військовослужбовців, а приклад використання технологій штучного інтелекту в рамках інформаційної війни. Їхнє завдання – створити ілюзію внутрішнього розколу та невдоволення, посіяти недовіру до державних інститутів і послабити стійкість українського суспільства.