Чень Пей-хуань

Оригінал публікації можна прочитати тут.

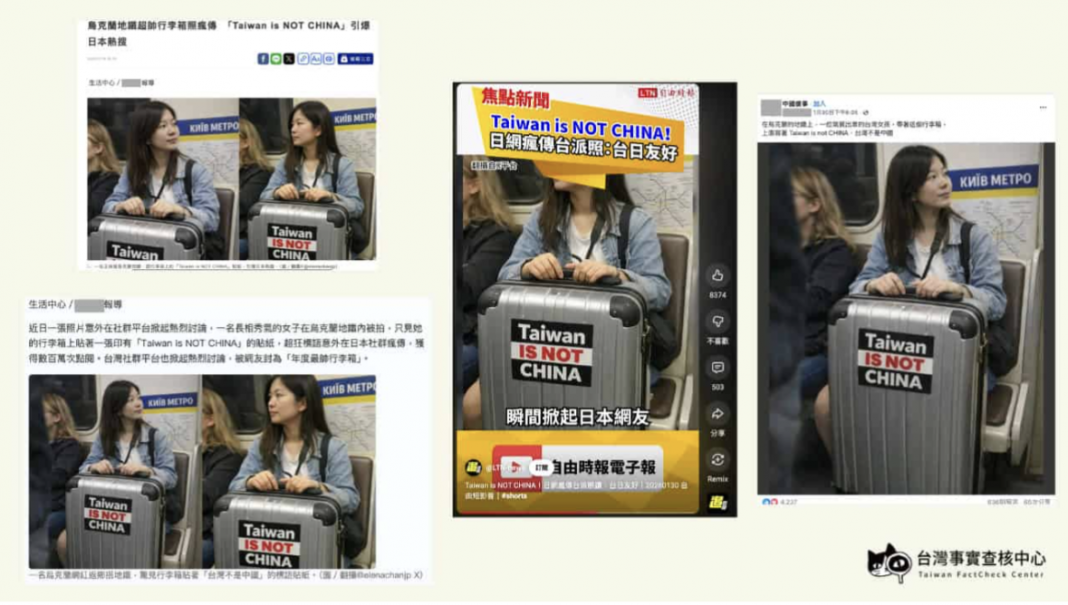

Останнім часом у соцмережах і медіа поширюють фотографію, нібито зроблену «у київському метро, в Україні, де жінка сидить із валізою з наліпкою «Taiwan is NOT CHINA» («Тайвань – не Китай»). Насправді це зображення не справжнє, згенероване за допомогою штучного інтелекту.

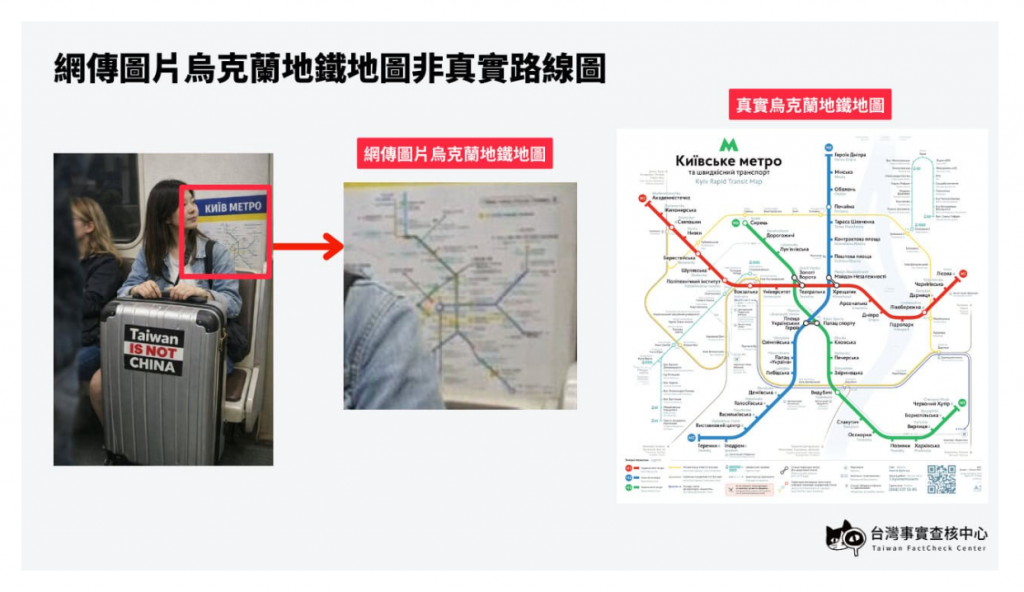

- Шен Ву-сун, українець корейського походження, який живе у Тайвані, звернув увагу, що схема метро на тлі поширюваного зображення не відповідає реальній схемі київського метро, що свідчить про ймовірне використання ШІ.

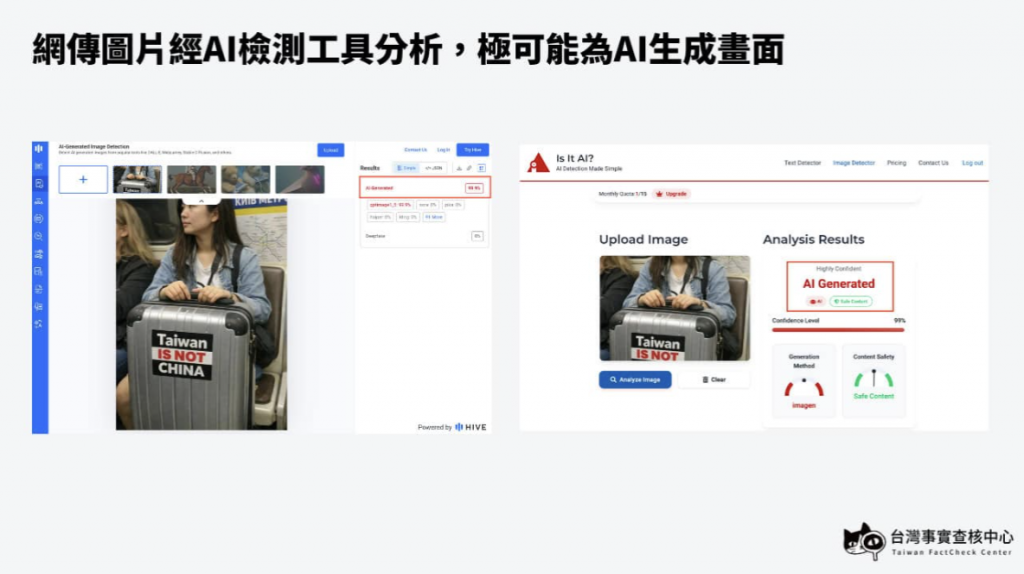

- Порівняння з офіційним туристичним путівником Київської міської адміністрації підтверджує, що схема ліній метро на поширюваному зображенні не відповідає офіційній версії та навіть містить граматичні помилки. Наліпка з гаслом на валізі виглядає неприродно гладкою, без деформацій чи зморшок уздовж рифленої поверхні валізи, що не відповідає фізичним властивостям реального тривимірного об’єкта — це виразна ознака зображення, згенерованого ШІ. Крім того, аналіз, проведений за допомогою інструментів для виявлення ШІ-зображень Is it AI? та Hive Moderation, показує, що це зображення з великою ймовірністю було створене штучним інтелектом.

- Фахівці з кібербезпеки застерігають, що сучасні технології ШІ стикаються з проблемою, коли «виявлення відстає від генерації». Вони радять користувачам покладатися на зворотний пошук зображень і відстежування джерел, повертаючись до базових принципів перевірки походження інформації та перехресної перевірки.

Отже, поширене зображення є неправдивим, адже воно згенероване ШІ.

Передісторія

Тайванські медіа, зокрема SETN (Sanli News Network), FTV News і Liberty Times, 30 січня повідомили, що посилаються на допис і зображення від 29 січня в акаунті «Elena Chan» на платформі X (колишньому Twitter). В описі йшлося, що українська інфлюенсерка, яка нібито живе в Японії, оприлюднила фото жінки в київському метро з валізою, на якій наклеєно наліпку «Taiwan is NOT CHINA».

Окрім публікацій у ЗМІ, цим зображенням поділилася й фейсбук-сторінка «China’s Absurdities», де зазначалося: «У метро в Україні елегантна тайванська дівчина їде з цією валізою, на якій написано “Taiwan is not CHINA”». Зображення також поширювали на інших онлайн-платформах, зокрема в Threads і на YouTube.

Фактчек

Фактчекер за допомогою зворотного пошуку виявив, що зображення, яке поширюють тайванські медіа та користувачі соцмереж, походить із двох фотографій у дописі від 29 січня в акаунті «Elena Chan» на платформі X. Текст допису японською «ほんとうですね» перекладається як «Справді так».

Схема маршрутів метро на поширюваному зображенні не відповідає офіційній версії, а наліпка на валізі має чіткі ознаки монтажу.

- Олександр Шин, засновник медіа Voice of Ukraine й українець корейського походження, який живе у Тайвані, в інтерв’ю зазначив, що це зображення згенероване ШІ. Він наголосив, що схема метро за спиною жінки повністю відрізняється від реальної схеми київського метро. Також Шин зауважив, що написання «Київ метро» на зображенні є некоректним, адже там поєднано два іменники — «Київ» і «метро», хоча потрібно було б – «Київське метро».

- Фактчекер звернувся до офіційного туристичного путівника Київської міської адміністрації й з’ясував, що конфігурація ліній метро там повністю відрізняється від схеми на поширюваному зображенні. Крім того, наліпка з гаслом на зображенні виглядає так, ніби «плаває» над поверхнею валізи. Якби справжню наліпку наклеїли на валізу з рельєфною поверхнею, вона мала б повторювати рельєф, провалюватися в жолобки або утворювати зморшки. Натомість наліпка виглядає як рівний аркуш, покладений зверху, без відчуття об’єму — це типова ознака змонтованого зображення.

- TFC застосував безкоштовні онлайн-інструменти для виявлення ШІ-зображень, такі як Is it AI? та Hive Moderation. Результати показали, що поширене зображення з великою ймовірністю є згенерованим ШІ.

Експерт із кібербезпеки: через стрімкий розвиток технологій генеративного ШІ варто повертатися до зворотного пошуку та відстежування джерел інформації

Дай Юй-чень, дослідник Інституту досліджень інформаційної безпеки, зазначив, що, стикаючись із зображеннями, згенерованими ШІ й поширеними в соцмережах, користувачі насамперед мають виробити звичку робити зворотний пошук цих зображень. Хоча окремі ШІ-зображення досі можна розпізнати на око, зі вдосконаленням генеративних моделей їх дедалі важче розпізнати.

За словами Дай Юй-ченя, нинішній розвиток ШІ супроводжується проблемою, коли технології виявлення відстають від технологій генерації. Оскільки індустрія вкладає значні ресурси в розробку та оптимізацію нових моделей, методи виявлення таких моделей часто можна тренувати й налаштовувати лише після того, як з’являється великий масив відповідних зображень. Це створює розрив між появою нової моделі й досягненням зрілості інструментів для виявлення, через що здається, ніби технології виявлення постійно «наздоганяють» генеративні.

Дослідник також застерігає, що не варто надмірно покладатися на один-єдиний «інструмент для виявлення ШІ». В умовах, коли технології безперервно розвиваються, а моделі постійно оновлюються, лише інструментів недостатньо для точного висновку; повернення до базових принципів відстежування походження інформації та перехресної перевірки з різних джерел є найнадійнішим способом захисту в цифрову добу.

Перепубліковано з вебсайту TFC у співпраці зі StopFake в межах Ukraine–Taiwan Initiative for Election Information Resilience.